LLM核心攻略制霸生成式AI:ChatGPT、嵌入技術、微調與多模態AI最佳實踐

-

79折 537元

680元

-

預計最高可得金幣25點

?

可100%折抵

預計最高可得金幣25點

?

可100%折抵

活動加倍另計 -

HAPPY GO享100累1點 4點抵1元折抵無上限

-

分類:中文書>電腦資訊>遊戲/數位生活>遊戲/麥塊Minecraf追蹤? 追蹤分類後,您會在第一時間收到分類新品通知。

- 作者: Sinan Ozdemir 追蹤 ? 追蹤作者後,您會在第一時間收到作者新書通知。

- 譯者:賴屹民

- 出版社: 碁峰資訊 追蹤 ? 追蹤出版社後,您會在第一時間收到出版社新書通知。

- 出版日:2025/03/24

活動訊息

內容簡介

內容簡介:🏆 Amazone 讀者5星好評 ⭐⭐⭐⭐⭐

🏆 微軟前總經理Shelia Gulati、Hugging Face首席倫理長 Giada Pistilli等業界領袖一致推薦!

「本書平衡了開源模型和閉源模型的潛力,鉅細靡遺地帶你瞭解和使用LLM,縮短理論概念和實際應用之間的距離。」—— Giada Pistilli ,Hugging Face 首席倫理長

「Ozdemir 的這本書為讀者破除重重迷霧,說明LLM 革命的起源,以及未來的發展方向。他將複雜主題拆解為實用的說明,和容易理解的範例程式。」

--Shelia Gulati, 微軟前總經理,Tola Capital現任常務董事

「本書是令人耳目一新並引發靈感的學習資源,充滿了實用的指導和清楚的講解,幫助你更瞭解這個奇妙的新領域。」

—PETE HUANG, author of The Neuron

🎯 想深入掌握LLM核心技術

🎯 想成為生成式AI應用的開發者

🎯 想在真實場景運用LLM解決問題

那你絕對不能錯過本書!

大型語言模型正以驚人的速度改變我們的工作與生活。無論是開發者、企業領袖,還是對AI有興趣的學習者,本書將引領你踏入這個革命性的領域。

🚩 完整拆解LLM核心技術— 從預訓練到微調,帶你輕鬆掌握關鍵概念原理。

🚩 實例操作直擊應用— 透過真實案例場景,運用最新工具和技術,快速上手專案開發。

🚩 開源與商用模型全解析— 精選LLM工具與資源,選擇最適切的解決方案。

這本實用的指南將逐步指導你在專案和產品中大規模地使用LLM。

Llama 3、Claude 3與GPT等大型語言模型(LLM)已展示驚人的實力,但它們的規模和複雜度,卻讓很多從業者望而卻步。創新的資料科學家暨AI企業家Sinan Ozdemir在本書第二版為你排除這些障礙,教你如何使用、整合和部署LLM來解決實際的問題。

Ozdemir把入門所需的知識整合起來,即使是沒有直接用過LLM的讀者也能輕鬆上手,本書內容包括逐步引導、最佳做法、真實案例研究、動手練習…等。在過程中,他也會分享關於LLM內部動作的見解,以協助你優化模型的選擇、資料格式、提示工程、微調效能…等。本書的網站提供許多資源,包括範例資料集,以及使用各種開源和閉源LLM的最新程式碼,那些LLM來自OpenAI(GPT-4與GPT-3.5)、Google(BERT、T5與Gemini)、X(Grok)、Anthropic(Claude家族)、Cohere(Command 家族),以及Meta(BART與LLaMA家族)。

SINAN OZDEMIR目前是LoopGenius的創辦人與CTO,同時擔任幾家AI公司的顧問。他曾在約翰·霍普金斯大學教導資料科學,並寫了多本關於資料科學和機器學習的教科書。

此外,他也創辦了最近被收購的Kylie.ai,這是一個具備RPA能力的企業級對話AI平台。他擁有約翰·霍普金斯大學的純數學碩士學位,現居於加州舊金山。

•學習關鍵的概念:預先訓練、遷移學習、微調、注意力機制、embedding、詞元化…等等。

•使用API和Python來微調及打造LLM,以滿足需求。

•建構完整的神經/語義資訊檢索系統,並附加至對話型LLM,以進行檢索增強生成(retrieval-augmented generation,RAG)機器人及AI Agents。

•掌握進階的提示工程技術,例如輸出結構化、思維鏈提示,及少量語義範例提示。

•使用自訂的LLM embedding,從零開始建立完整的推薦引擎,並透過用戶資料來讓效能超越 OpenAI的現成embedding。

•使用開源的LLM和大型視覺資料集,從零開始建構並微調多模態Transformer架構。

•使用Reinforcement Learning from Human and AI Feedback(RLHF/RLAIF)來調校LLM,並基於Llama 3和FLAN-T5等開源模型來建立對話agent。

•將提示詞和微調過的自訂LLM部署至雲端,同時預先考慮擴展和演進流水線。

•透過量化、探測、效能評測與評估框架,來診斷與優化LLM的速度、記憶體用量及整體效能。

🏆 微軟前總經理Shelia Gulati、Hugging Face首席倫理長 Giada Pistilli等業界領袖一致推薦!

「本書平衡了開源模型和閉源模型的潛力,鉅細靡遺地帶你瞭解和使用LLM,縮短理論概念和實際應用之間的距離。」—— Giada Pistilli ,Hugging Face 首席倫理長

「Ozdemir 的這本書為讀者破除重重迷霧,說明LLM 革命的起源,以及未來的發展方向。他將複雜主題拆解為實用的說明,和容易理解的範例程式。」

--Shelia Gulati, 微軟前總經理,Tola Capital現任常務董事

「本書是令人耳目一新並引發靈感的學習資源,充滿了實用的指導和清楚的講解,幫助你更瞭解這個奇妙的新領域。」

—PETE HUANG, author of The Neuron

🎯 想深入掌握LLM核心技術

🎯 想成為生成式AI應用的開發者

🎯 想在真實場景運用LLM解決問題

那你絕對不能錯過本書!

大型語言模型正以驚人的速度改變我們的工作與生活。無論是開發者、企業領袖,還是對AI有興趣的學習者,本書將引領你踏入這個革命性的領域。

🚩 完整拆解LLM核心技術— 從預訓練到微調,帶你輕鬆掌握關鍵概念原理。

🚩 實例操作直擊應用— 透過真實案例場景,運用最新工具和技術,快速上手專案開發。

🚩 開源與商用模型全解析— 精選LLM工具與資源,選擇最適切的解決方案。

這本實用的指南將逐步指導你在專案和產品中大規模地使用LLM。

Llama 3、Claude 3與GPT等大型語言模型(LLM)已展示驚人的實力,但它們的規模和複雜度,卻讓很多從業者望而卻步。創新的資料科學家暨AI企業家Sinan Ozdemir在本書第二版為你排除這些障礙,教你如何使用、整合和部署LLM來解決實際的問題。

Ozdemir把入門所需的知識整合起來,即使是沒有直接用過LLM的讀者也能輕鬆上手,本書內容包括逐步引導、最佳做法、真實案例研究、動手練習…等。在過程中,他也會分享關於LLM內部動作的見解,以協助你優化模型的選擇、資料格式、提示工程、微調效能…等。本書的網站提供許多資源,包括範例資料集,以及使用各種開源和閉源LLM的最新程式碼,那些LLM來自OpenAI(GPT-4與GPT-3.5)、Google(BERT、T5與Gemini)、X(Grok)、Anthropic(Claude家族)、Cohere(Command 家族),以及Meta(BART與LLaMA家族)。

SINAN OZDEMIR目前是LoopGenius的創辦人與CTO,同時擔任幾家AI公司的顧問。他曾在約翰·霍普金斯大學教導資料科學,並寫了多本關於資料科學和機器學習的教科書。

此外,他也創辦了最近被收購的Kylie.ai,這是一個具備RPA能力的企業級對話AI平台。他擁有約翰·霍普金斯大學的純數學碩士學位,現居於加州舊金山。

•學習關鍵的概念:預先訓練、遷移學習、微調、注意力機制、embedding、詞元化…等等。

•使用API和Python來微調及打造LLM,以滿足需求。

•建構完整的神經/語義資訊檢索系統,並附加至對話型LLM,以進行檢索增強生成(retrieval-augmented generation,RAG)機器人及AI Agents。

•掌握進階的提示工程技術,例如輸出結構化、思維鏈提示,及少量語義範例提示。

•使用自訂的LLM embedding,從零開始建立完整的推薦引擎,並透過用戶資料來讓效能超越 OpenAI的現成embedding。

•使用開源的LLM和大型視覺資料集,從零開始建構並微調多模態Transformer架構。

•使用Reinforcement Learning from Human and AI Feedback(RLHF/RLAIF)來調校LLM,並基於Llama 3和FLAN-T5等開源模型來建立對話agent。

•將提示詞和微調過的自訂LLM部署至雲端,同時預先考慮擴展和演進流水線。

•透過量化、探測、效能評測與評估框架,來診斷與優化LLM的速度、記憶體用量及整體效能。

目錄

序

前言

致謝

關於作者

PART I 大型語言模型簡介

1 大型語言模型概述

大型語言模型是什麼?

流行的現代LLM

LLM的應用

結論

2 使用LLM來進行語意搜尋

前言

任務

解決方案概要

組件

整合一切

使用閉源組件的成本

結論

3 踏出提示工程的第一步

前言

提示工程

在不同模型之間使用提示

結論

4 AI生態系統:整合所有組件

前言

閉源AI的效能不斷變動

AI推理vs.思考

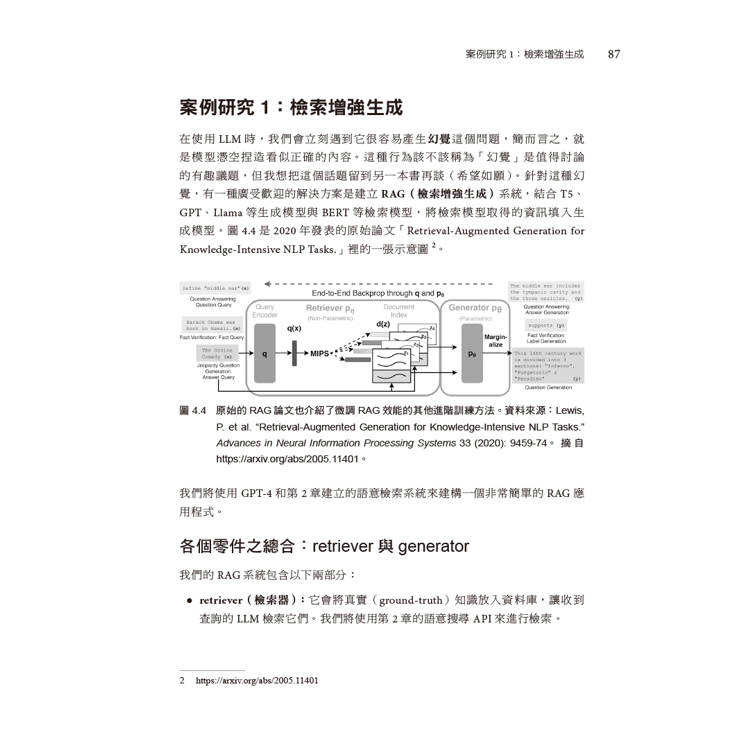

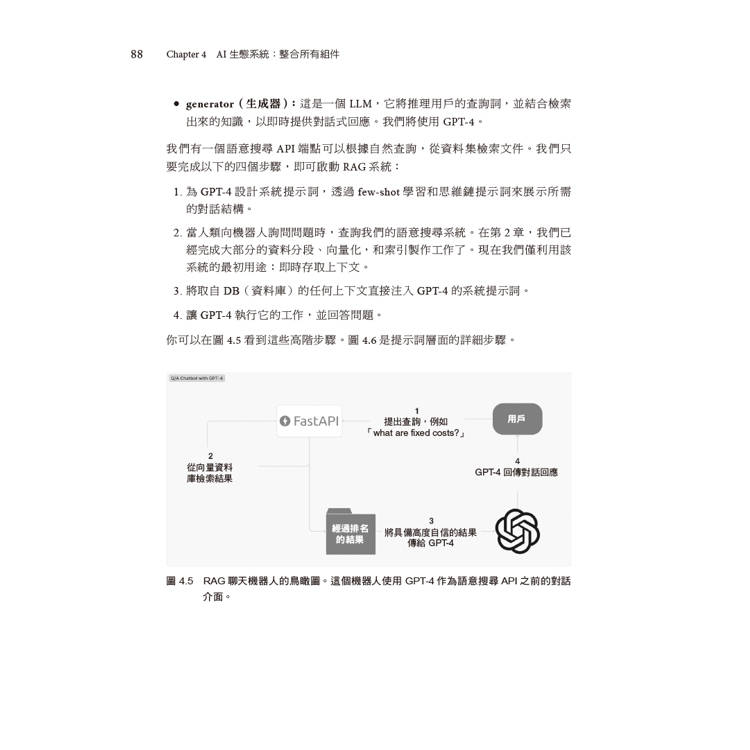

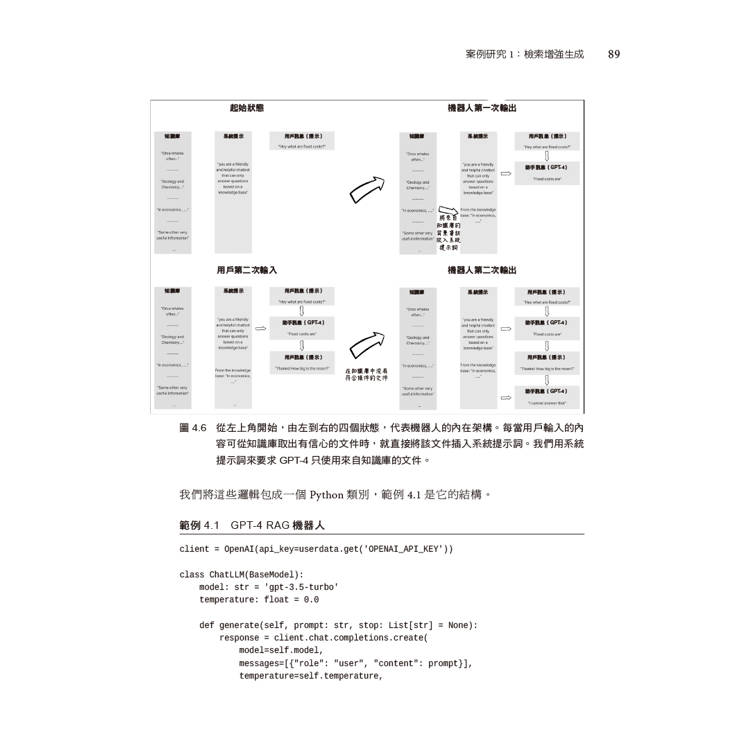

案例研究1:檢索增強生成

案例研究2:自動AIagent

結論

PART II 榨出LLM的所有潛力

5 使用自訂的微調來優化LLM

前言

遷移學習和微調:入門指南

OpenAI微調API概要

使用OpenAICLI來準備自訂範例

設定OpenAICLI

我們微調的第一個LLM

結論

6 進階提示工程

前言

提示注入攻擊

輸入/輸出驗證

批次提示

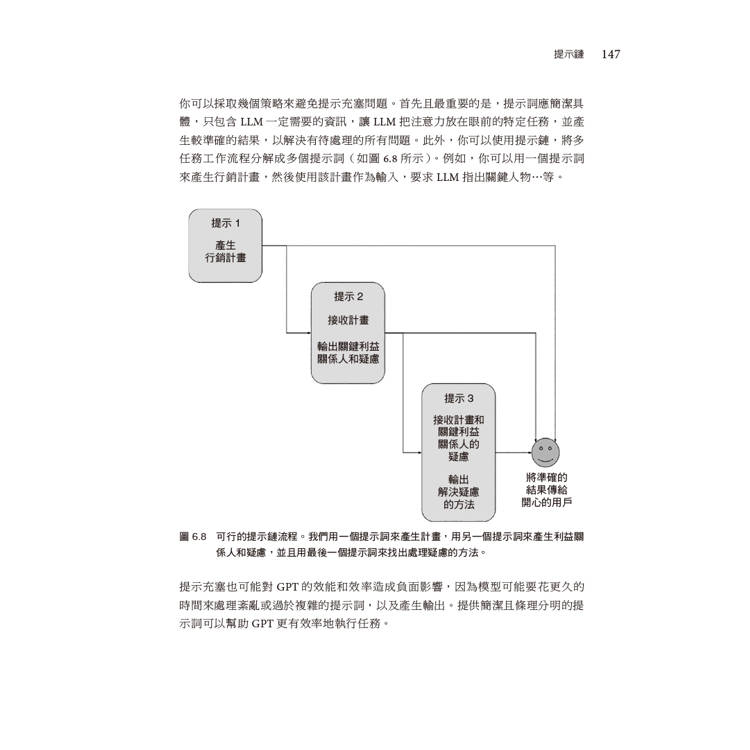

提示鏈

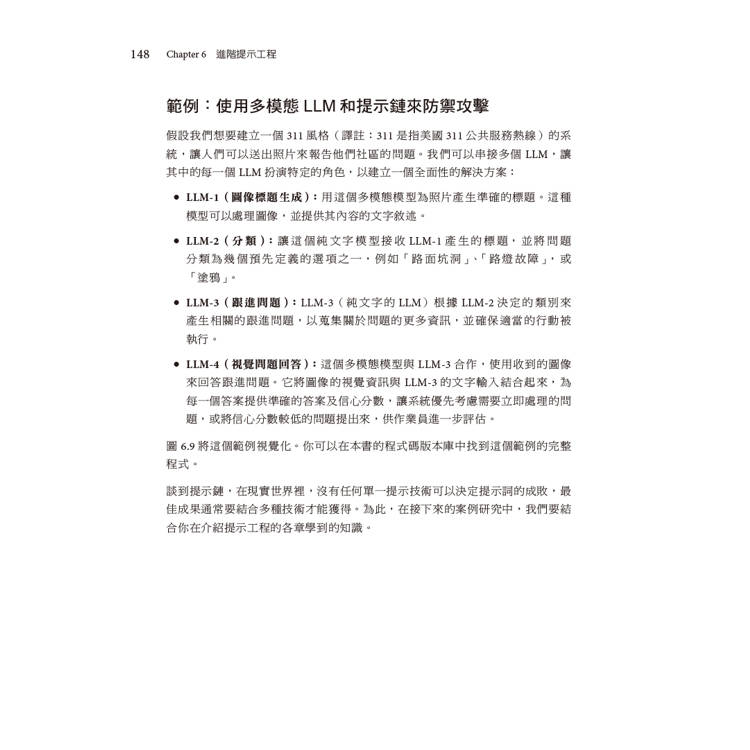

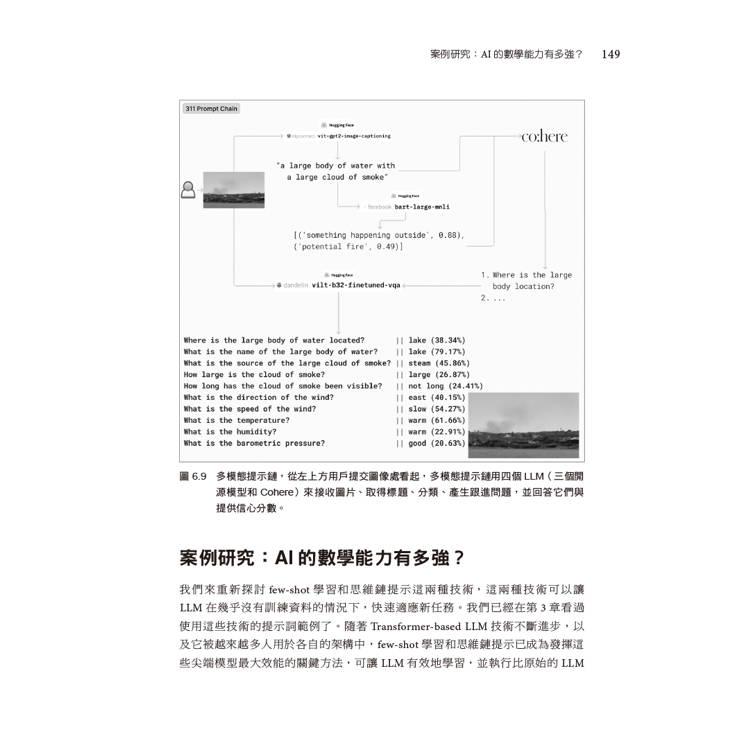

案例研究:AI的數學能力有多強?

結論

7 自訂embedding與模型架構

前言

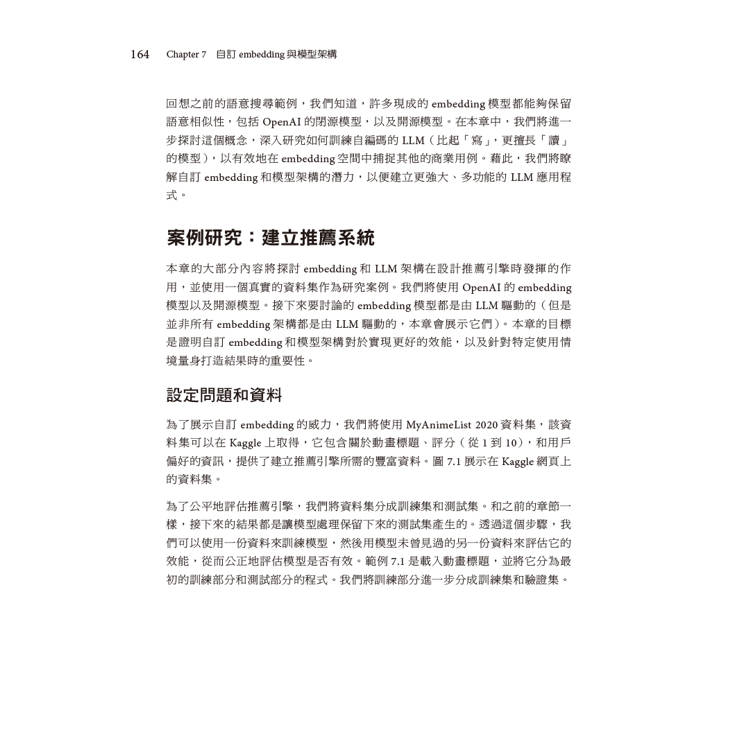

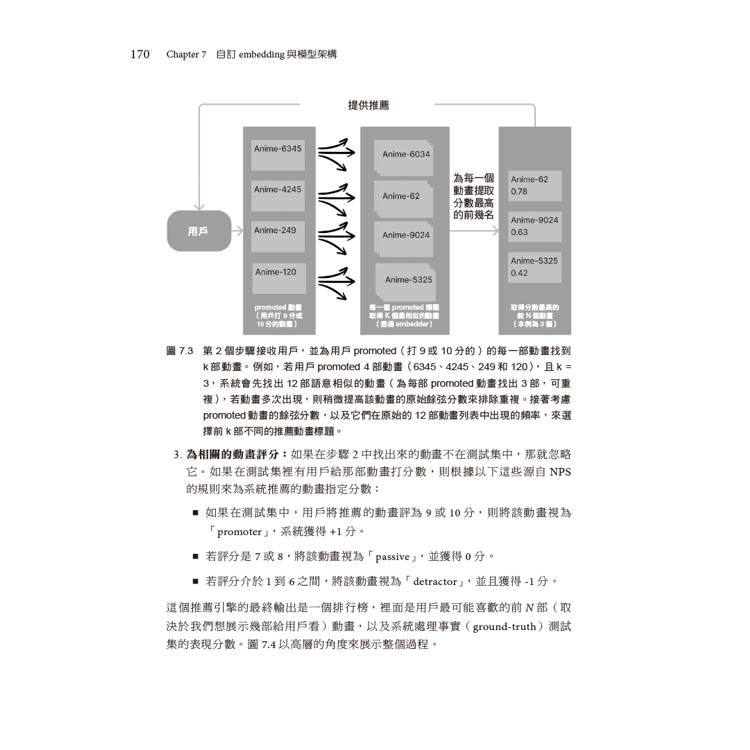

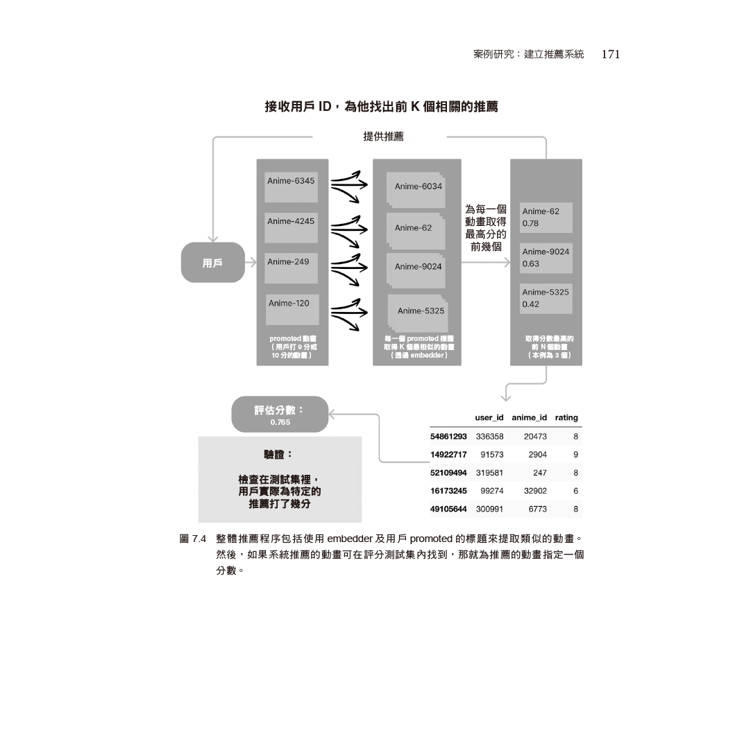

案例研究:建立推薦系統

結論

8 AI對齊:第一原則

前言

對齊的對象是誰?為了什麼目的?

對齊可以降低偏見的嚴重性

對齊的支柱

憲法AI:邁向自我對齊的一步

結論

PART III LLM進階用法

9 超越基礎模型

前言

案例研究:視覺問答

案例研究:透過回饋來進行強化學習

結論

10 微調進階的開源LLM

前言

範例:使用BERT來做動畫類型多標籤分類

範例:使用GPT2來生成LaTeX

Sinan’sAttemptatWiseYetEngagingResponses:SAWYER

結論

11 將LLM投入生產

前言

將閉源LLM部署至生產環境

將開源LLM部署至生產環境

結論

12 評估LLM

前言

評估生成任務

評估理解任務

結論

繼續前進!

PART IV 附錄

A LLM FAQ

B LLM詞彙表

C LLM應用程式原型

索引

前言

致謝

關於作者

PART I 大型語言模型簡介

1 大型語言模型概述

大型語言模型是什麼?

流行的現代LLM

LLM的應用

結論

2 使用LLM來進行語意搜尋

前言

任務

解決方案概要

組件

整合一切

使用閉源組件的成本

結論

3 踏出提示工程的第一步

前言

提示工程

在不同模型之間使用提示

結論

4 AI生態系統:整合所有組件

前言

閉源AI的效能不斷變動

AI推理vs.思考

案例研究1:檢索增強生成

案例研究2:自動AIagent

結論

PART II 榨出LLM的所有潛力

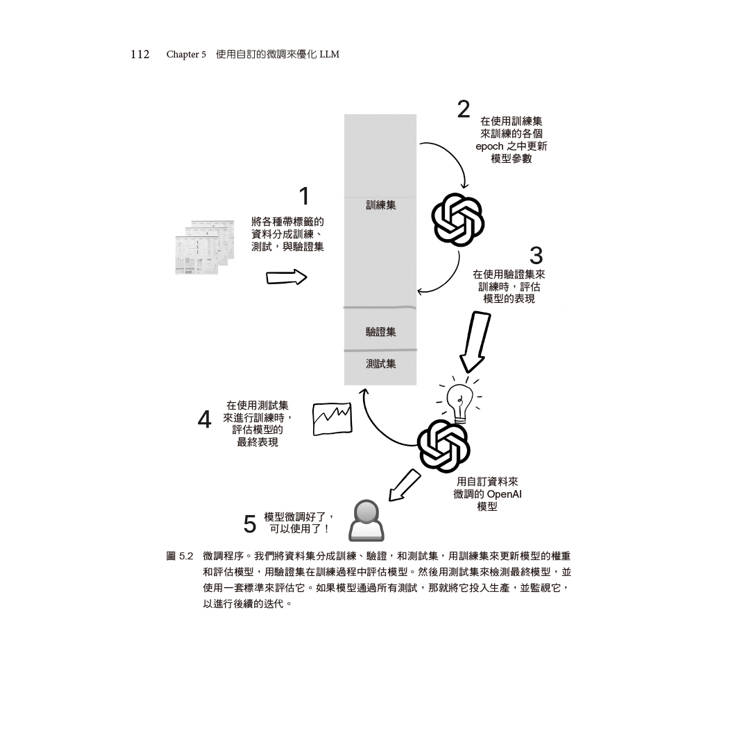

5 使用自訂的微調來優化LLM

前言

遷移學習和微調:入門指南

OpenAI微調API概要

使用OpenAICLI來準備自訂範例

設定OpenAICLI

我們微調的第一個LLM

結論

6 進階提示工程

前言

提示注入攻擊

輸入/輸出驗證

批次提示

提示鏈

案例研究:AI的數學能力有多強?

結論

7 自訂embedding與模型架構

前言

案例研究:建立推薦系統

結論

8 AI對齊:第一原則

前言

對齊的對象是誰?為了什麼目的?

對齊可以降低偏見的嚴重性

對齊的支柱

憲法AI:邁向自我對齊的一步

結論

PART III LLM進階用法

9 超越基礎模型

前言

案例研究:視覺問答

案例研究:透過回饋來進行強化學習

結論

10 微調進階的開源LLM

前言

範例:使用BERT來做動畫類型多標籤分類

範例:使用GPT2來生成LaTeX

Sinan’sAttemptatWiseYetEngagingResponses:SAWYER

結論

11 將LLM投入生產

前言

將閉源LLM部署至生產環境

將開源LLM部署至生產環境

結論

12 評估LLM

前言

評估生成任務

評估理解任務

結論

繼續前進!

PART IV 附錄

A LLM FAQ

B LLM詞彙表

C LLM應用程式原型

索引

配送方式

-

台灣

- 國內宅配:本島、離島

-

到店取貨:

不限金額免運費

-

海外

- 國際快遞:全球

-

港澳店取:

詳細資料

詳細資料

-

- 語言

- 中文繁體

- 裝訂

- 紙本平裝

-

- ISBN

- 9786264250061

- 分級

- 普通級

-

- 頁數

- 432

- 商品規格

- 18開17*23cm

-

- 出版地

- 台灣

- 適讀年齡

- 全齡適讀

-

- 注音

- 級別

訂購/退換貨須知

退換貨須知:

**提醒您,鑑賞期不等於試用期,退回商品須為全新狀態**

-

依據「消費者保護法」第19條及行政院消費者保護處公告之「通訊交易解除權合理例外情事適用準則」,以下商品購買後,除商品本身有瑕疵外,將不提供7天的猶豫期:

- 易於腐敗、保存期限較短或解約時即將逾期。(如:生鮮食品)

- 依消費者要求所為之客製化給付。(客製化商品)

- 報紙、期刊或雜誌。(含MOOK、外文雜誌)

- 經消費者拆封之影音商品或電腦軟體。

- 非以有形媒介提供之數位內容或一經提供即為完成之線上服務,經消費者事先同意始提供。(如:電子書、電子雜誌、下載版軟體、虛擬商品…等)

- 已拆封之個人衛生用品。(如:內衣褲、刮鬍刀、除毛刀…等)

- 若非上列種類商品,均享有到貨7天的猶豫期(含例假日)。

- 辦理退換貨時,商品(組合商品恕無法接受單獨退貨)必須是您收到商品時的原始狀態(包含商品本體、配件、贈品、保證書、所有附隨資料文件及原廠內外包裝…等),請勿直接使用原廠包裝寄送,或於原廠包裝上黏貼紙張或書寫文字。

- 退回商品若無法回復原狀,將請您負擔回復原狀所需費用,嚴重時將影響您的退貨權益。

商品評價