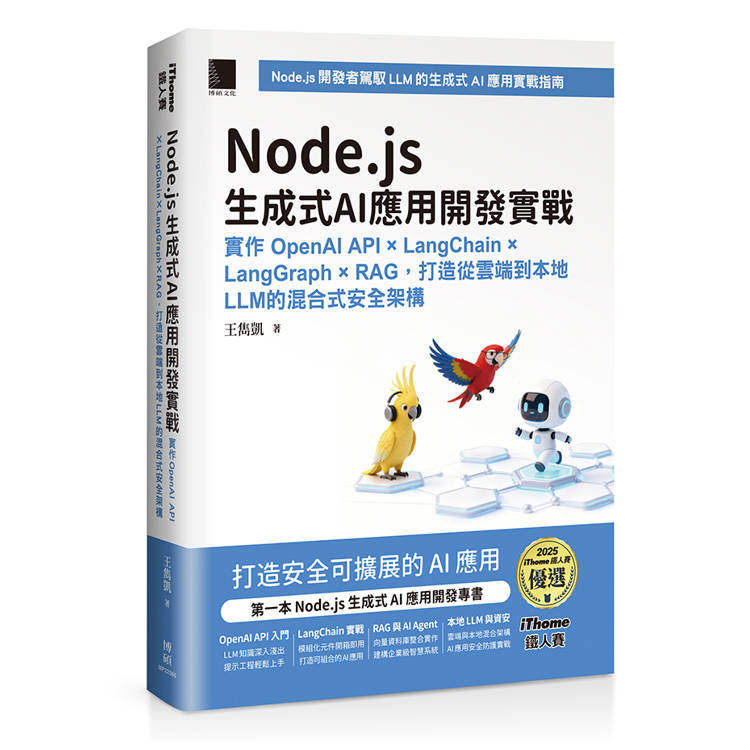

Node.js生成式AI應用開發實戰:實作OpenAI API × LangChain × LangGraph × RAG,打造從雲端到本地LLM的混合式安全架構(iThome鐵人賽系列書)

活動訊息

內容簡介

本書內容改編自第17屆iThome鐵人賽生成式AI組優選系列文章《用Node.js打造生成式AI應用:從Prompt到Agent開發實戰》。以Node.js打造生成式AI應用為主軸,透過完整的實戰範例,協助開發者快速熟悉AI工具鏈。本書分為五大篇章,循序漸進地帶領讀者掌握生成式AI應用開發的關鍵要素:

✪PART 1 OpenAI API基礎應用:瞭解LLM核心概念,掌握OpenAI API使用模式、提示工程與函式呼叫。

✪PART 2 LangChain核心應用:掌握LangChain提示模板、結構化輸出、LCEL流程鏈與工具代理整合。

✪PART 3 RAG實戰應用:實作文件載入與分割,整合嵌入模型與向量資料庫建構RAG問答系統。

✪PART 4 LangGraph AI Agent實作:建構具備多代理協作、人機互動、記憶管理與MCP整合能力的AI Agent。

✪PART 5 本地LLM部署與安全設計:整合Ollama與LiteLLM建構雲地混合模型架構,並涵蓋資安防護策略。

第一本Node.js開發者駕馭LLM的生成式AI應用實戰指南

OpenAI API × LangChain × LangGraph × RAG

從零開始打造專屬你的生成式AI應用!

【專業推薦】

如果你拿到這本書,記得不要只是照做,多去思考作者的選擇邏輯。要知道半年、一年後,技術可能就變了,書裡的具體做法可能就過時了。但如果你學到的是一位資深工程師怎麼看待新技術、怎麼做選擇,那這個能力不會過期。

─ 張天豪,永豐金控科技長

這不是一本「介紹AI有多厲害」的書。它在做的事情,是告訴你怎麼把LLM變成一個可以放進系統裡、可以維運、可以信任的元件。這是一條從一開始「能跑」走到最後「能上線」的完整路徑,而不只是把技術點攤開來的知識拼盤。

─ 周立夫,永豐金控數位科技處副處長

【內容簡介】

♚OpenAI API入門:LLM知識深入淺出,提示工程輕鬆上手

♚LangChain實戰:模組化元件開箱即用,打造可組合的AI應用

♚RAG與AI Agent:向量資料庫整合實作,建構企業級智慧系統

♚本地LLM與資安:雲端與本地混合架構,AI應用安全防護實戰

本書內容改編自第17屆iThome鐵人賽生成式AI組優選系列文章《用Node.js打造生成式AI應用:從Prompt到Agent開發實戰》。以Node.js打造生成式AI應用為主軸,透過完整的實戰範例,協助開發者快速熟悉AI工具鏈。本書分為五大篇章,循序漸進地帶領讀者掌握生成式AI應用開發的關鍵要素:

✪PART 1 OpenAI API基礎應用:瞭解LLM核心概念,掌握OpenAI API使用模式、提示工程與函式呼叫。

✪PART 2 LangChain核心應用:掌握LangChain提示模板、結構化輸出、LCEL流程鏈與工具代理整合。

✪PART 3 RAG實戰應用:實作文件載入與分割,整合嵌入模型與向量資料庫建構RAG問答系統。

✪PART 4 LangGraph AI Agent實作:建構具備多代理協作、人機互動、記憶管理與MCP整合能力的AI Agent。

✪PART 5 本地LLM部署與安全設計:整合Ollama與LiteLLM建構雲地混合模型架構,並涵蓋資安防護策略。

【目標讀者】

✪想從OpenAI API 起步進入AI應用開發的入門者。

✪想使用JS生態圈工具打造生成式AI應用的Node.js開發者。

✪想運用自有知識庫打造RAG應用的企業內部技術團隊。

✪想掌握生成式AI系統設計原則、部署模式與安全風險評估的技術主管與架構師。

✪想理解LangChain、LangGraph、Ollama等框架的獨立開發者與技術創作者。

✪PART 1 OpenAI API基礎應用:瞭解LLM核心概念,掌握OpenAI API使用模式、提示工程與函式呼叫。

✪PART 2 LangChain核心應用:掌握LangChain提示模板、結構化輸出、LCEL流程鏈與工具代理整合。

✪PART 3 RAG實戰應用:實作文件載入與分割,整合嵌入模型與向量資料庫建構RAG問答系統。

✪PART 4 LangGraph AI Agent實作:建構具備多代理協作、人機互動、記憶管理與MCP整合能力的AI Agent。

✪PART 5 本地LLM部署與安全設計:整合Ollama與LiteLLM建構雲地混合模型架構,並涵蓋資安防護策略。

第一本Node.js開發者駕馭LLM的生成式AI應用實戰指南

OpenAI API × LangChain × LangGraph × RAG

從零開始打造專屬你的生成式AI應用!

【專業推薦】

如果你拿到這本書,記得不要只是照做,多去思考作者的選擇邏輯。要知道半年、一年後,技術可能就變了,書裡的具體做法可能就過時了。但如果你學到的是一位資深工程師怎麼看待新技術、怎麼做選擇,那這個能力不會過期。

─ 張天豪,永豐金控科技長

這不是一本「介紹AI有多厲害」的書。它在做的事情,是告訴你怎麼把LLM變成一個可以放進系統裡、可以維運、可以信任的元件。這是一條從一開始「能跑」走到最後「能上線」的完整路徑,而不只是把技術點攤開來的知識拼盤。

─ 周立夫,永豐金控數位科技處副處長

【內容簡介】

♚OpenAI API入門:LLM知識深入淺出,提示工程輕鬆上手

♚LangChain實戰:模組化元件開箱即用,打造可組合的AI應用

♚RAG與AI Agent:向量資料庫整合實作,建構企業級智慧系統

♚本地LLM與資安:雲端與本地混合架構,AI應用安全防護實戰

本書內容改編自第17屆iThome鐵人賽生成式AI組優選系列文章《用Node.js打造生成式AI應用:從Prompt到Agent開發實戰》。以Node.js打造生成式AI應用為主軸,透過完整的實戰範例,協助開發者快速熟悉AI工具鏈。本書分為五大篇章,循序漸進地帶領讀者掌握生成式AI應用開發的關鍵要素:

✪PART 1 OpenAI API基礎應用:瞭解LLM核心概念,掌握OpenAI API使用模式、提示工程與函式呼叫。

✪PART 2 LangChain核心應用:掌握LangChain提示模板、結構化輸出、LCEL流程鏈與工具代理整合。

✪PART 3 RAG實戰應用:實作文件載入與分割,整合嵌入模型與向量資料庫建構RAG問答系統。

✪PART 4 LangGraph AI Agent實作:建構具備多代理協作、人機互動、記憶管理與MCP整合能力的AI Agent。

✪PART 5 本地LLM部署與安全設計:整合Ollama與LiteLLM建構雲地混合模型架構,並涵蓋資安防護策略。

【目標讀者】

✪想從OpenAI API 起步進入AI應用開發的入門者。

✪想使用JS生態圈工具打造生成式AI應用的Node.js開發者。

✪想運用自有知識庫打造RAG應用的企業內部技術團隊。

✪想掌握生成式AI系統設計原則、部署模式與安全風險評估的技術主管與架構師。

✪想理解LangChain、LangGraph、Ollama等框架的獨立開發者與技術創作者。

目錄

【Part 01 OpenAI API基礎應用】

|Chapter 01| 理解大型語言模型的核心概念

1.1 生成式AI的時代:從規則到語言理解

1.2 大型語言模型的核心概念

1.3 大型語言模型的能力與限制

|Chapter 02| 掌握OpenAI API的使用模式

2.1 為什麼選擇OpenAI

2.2 為什麼要使用AP

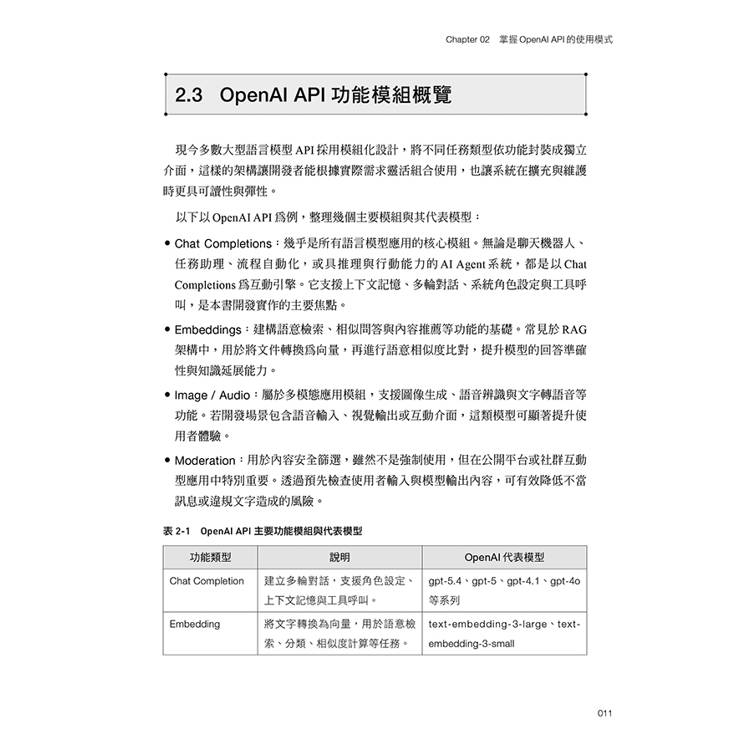

2.3 OpenAI API功能模組概覽

2.4 OpenAI GPT系列模型

2.5 Chat Completions API:對話核心介面

2.6 Responses API:支援狀態管理的對話介面

2.7 申請與管理OpenAI API金鑰

2.8 測試Chat Completion API

2.9 API使用限制與開發注意事項

|Chapter 03| 使用OpenAI API建立第一個應用

3.1 建立第一個OpenAI專案

3.2 專案初始化與環境準備

3.3 實作:建立可互動的終端機聊天機器人

3.4 提升對話體驗:使用串流模式

3.5 實作:支援串流模式的終端機聊天機器人

3.6 理解多輪對話機制:上下文與訊息角色

3.7 實作:支援多輪對話的終端機聊天機器人

|Chapter 04| 運用提示工程打造可控的角色與回應

4.1 認識提示工程:讓模型更懂你的指令

4.2 掌握提示結構:結合角色、任務與上下文

4.3 提示設計技巧:常用的引導方法與模式

4.4 實作:讓終端機聊天機器人擁有角色意識

|Chapter 05| 調控取樣參數Temperature與Top-P

5.1 理解模型如何生成回應

5.2 為何需要隨機性:從穩定回應到創意輸出

5.3 Temperature:控制模型的創意程度

5.4 Top-P:限制模型的選詞範圍

5.5 實作:讓CLI聊天機器人支援隨機性參數調整

|Chapter 06| 使用Function Calling讓模型呼叫工具

6.1 理解Function Calling機制

6.2 建立並執行Function Calling

6.3 實作:打造支援網路搜尋的終端機聊天機器人

【Part 02 LangChain核心應用】

|Chapter 07| 理解LangChain的核心概念與生態系

7.1 為什麼需要LangChain:從模型能力到應用挑戰

7.2 認識LangChain:打造LLM應用的核心框架

7.3 LangChain生態系:完整的應用開發平台

|Chapter 08| 使用LangChain建立LLM應用程式

8.1 建立第一個LangChain專案

8.2 專案初始化與環境準備

8.3 建立可互動的終端機聊天機器人

8.4 打造支援多輪對話的聊天機器人

8.5 使用串流模式提升對話體驗

|Chapter 09| 設計LangChain提示模板

9.1 為什麼需要提示模板

9.2 PromptTemplate:建立文字提示模板

9.3 ChatPromptTemplate:建立多角色對話提示

9.4 MessagesPlaceholder:插入歷史對話脈絡

|Chapter 10| 解析LangChain結構化輸出

10.1 為什麼需要輸出解析器

10.2 LangChain輸出解析器的運作流程

10.3 StringOutputParser:解析純文字輸出

10.4 JsonOutputParser:解析JSON輸出

10.5 CommaSeparatedListOutputParser:解析逗號分隔清單

10.6 StructuredOutputParser:結構與型別驗證輸出

10.7 OutputFixingParser:自動修復輸出

10.8 使用模型原生的結構化輸出

|Chapter 11| 使用LCEL組合流程鏈

11.1 認識LCEL

11.2 Runnable:LCEL的基本組成

11.3 RunnableSequence:順序執行Runnable

11.4 RunnableParallel:多個Runnable平行執行

11.5 RunnableLambda:自訂處理邏輯

11.6 LCEL的適用場景

|Chapter 12| 整合LangChain工具與代理

12.1 從工具到代理:讓模型具備行動力

12.2 Tool:讓模型能執行外部任務

12.3 Agent:讓模型自主決策與行動

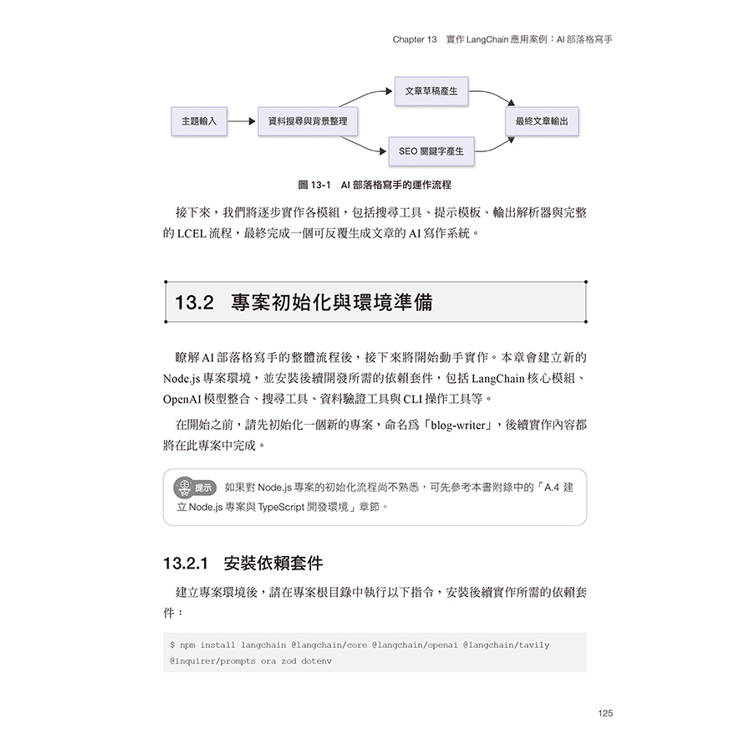

|Chapter 13| 實作LangChain應用案例:AI部落格寫手

13.1 打造具網路搜尋能力的AI部落格寫手

13.2 專案初始化與環境準備

13.3 實作:具搜尋能力的AI部落格寫手

|Chapter 14| 追蹤與觀測LangChain執行流程

14.1 LLM應用的流程追蹤與可觀測性

14.2 LangChain的流程追蹤工具

14.3 Verbose模式:開發階段的即時追蹤與除錯

14.4 LangSmith:適用生產環境的可觀測平台

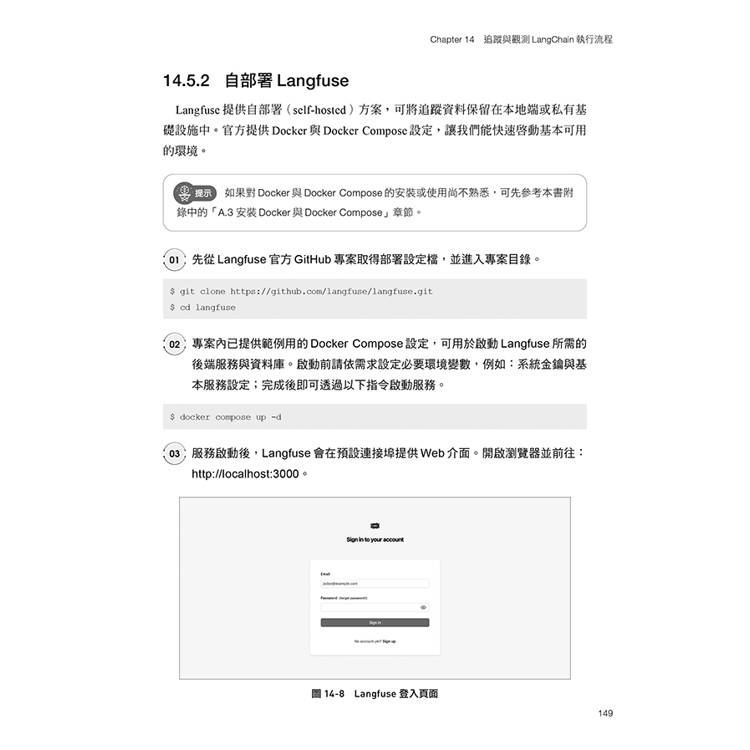

14.5 Langfuse:可自部署的LLM可觀測平台

【Part 03 RAG實戰應用】

|Chapter 15| 理解檢索增強生成

15.1 認識RAG

15.2 RAG的核心概念

15.3 LangChain如何支援RAG

|Chapter 16| 載入與分割文件

16.1 為什麼要載入與分割文件

16.2 文件載入器:將不同來源轉換為統一格式

16.3 文本分割器:將內容分割為可處理片段

|Chapter 17| 使用嵌入模型與向量資料庫

17.1 認識嵌入模型

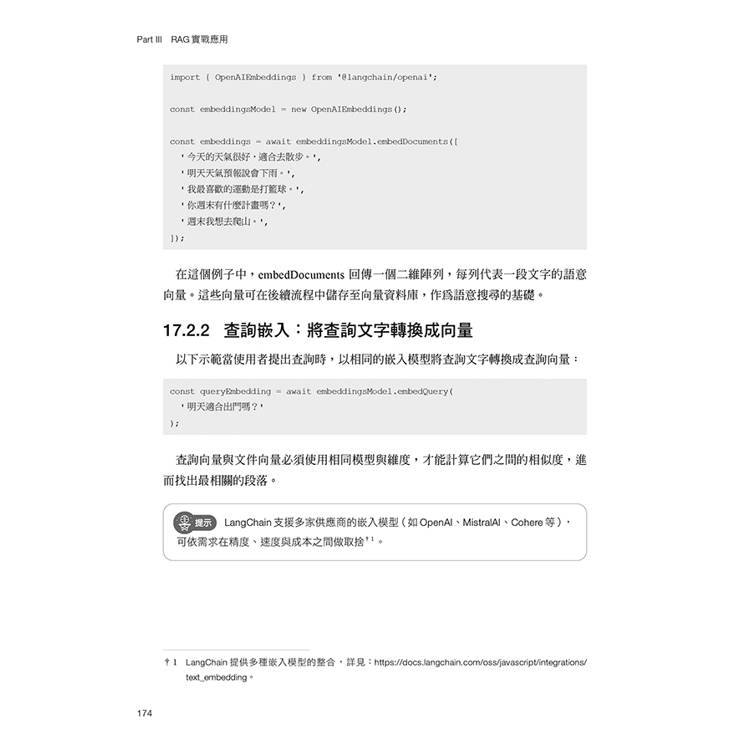

17.2 語意向量的建立與查詢

17.3 認識向量資料庫

17.4 在LangChain中使用VectorStore

|Chapter 18| 結合檢索與生成

18.1 Retriever:封裝語意搜尋流程

18.2 建立基本的RAG流程

18.3 建立RAG Agent

|Chapter 19| 實作RAG應用案例:文件問答助理

19.1 打造可檢索公司年報的AI問答助理

19.2 專案初始化與環境準備

19.3 實作:可檢索公司年報的AI問答助理

【Part 04 LangGraph AI Agent實作】

|Chapter 20| 理解LangGraph的流程架構

20.1 為什麼需要LangGraph:從流程鏈到圖狀工作流

20.2 LangGraph的核心設計:以Graph描述Agent流程

20.3 State:LangGraph的核心資料結構

20.4 Nodes:LangGraph中的任務執行單位

20.5 Edges:決定流程要怎麼走

|Chapter 21| 使用LangGraph建立Agent流程

21.1 建立你的第一個LangGraph專案

21.2 專案初始化與環境準備

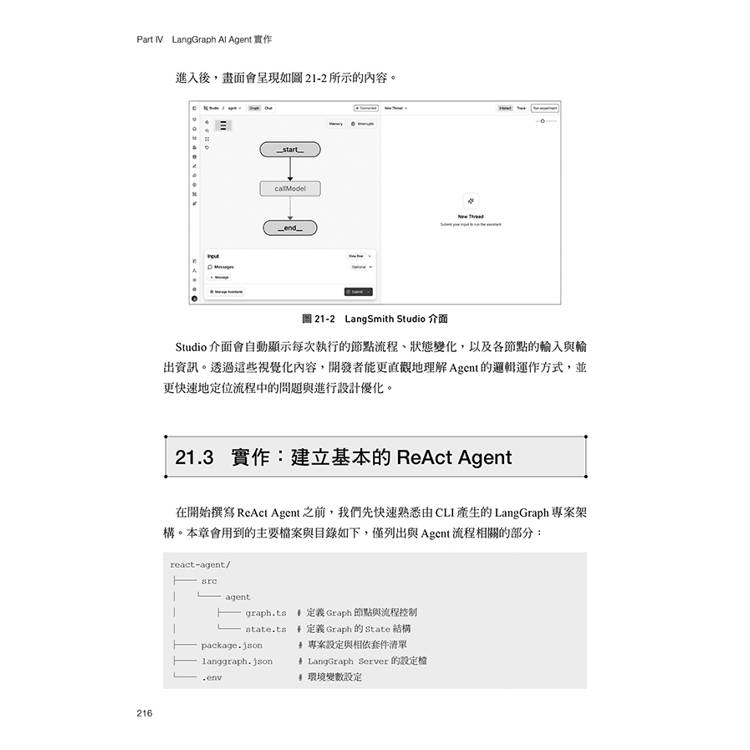

21.3 實作:建立基本的ReAct Agent

|Chapter 22| 打造多代理協作系統

22.1 為什麼需要多代理系統

22.2 多代理系統的設計模式

22.3 使用LangGraph實作多代理系統

22.4 設計多代理架構的協作模式

|Chapter 23| 設計人機協作流程

23.1 為什麼需要人機協作

23.2 LLM應用中的人機協作場景

23.3 使用LangGraph實現人機協作

23.4 人機協作的設計模式

23.5 使用Agent Middleware實作人機協作

|Chapter 24| 管理AI Agent記憶

24.1 認識AI Agent的記憶

24.2 短期記憶與長期記憶

24.3 短期記憶:追蹤當前對話與任務狀態

24.4 短期記憶的管理策略

24.5 長期記憶:跨會話的偏好與知識保存

24.6 設計長期記憶時的考量

|Chapter 25| 透過MCP連接第三方工具與資源

25.1 認識MCP

25.2 建立你的第一個MCP Server

25.3 建立MCP Client並呼叫工具

25.4 在LangGraph中整合MCP工具

25.5 整合外部服務:連接第三方MCP Server

|Chapter 26| 實作LangGraph應用案例:可審核與修訂的AI寫作Agent

26.1 打造具網路搜尋與人機協作能力的AI寫作Agent

26.2 專案初始化與環境準備

26.3 實作:具網路搜尋與人機協作能力的AI寫作Agent

26.4 建立CLI客戶端

|Chapter 27| 探索深度代理架構

27.1 認識深度代理

27.2 深度代理的四大核心支柱

27.3 打造並客製你的深度代理

【Part 05 本地LLM部署與安全設計】

|Chapter 28| 理解本地LLM的部署方案

28.1 為什麼需要在本地部署LLM

28.2 本地LLM部署的挑戰

28.3 常見的本地LLM部署方案

28.4 Hugging Face:模型生態與工具平台

28.5 常見的開放權重模型選擇

|Chapter 29| 使用Ollama管理本地模型

29.1 為什麼選擇Ollama

29.2 安裝Ollama

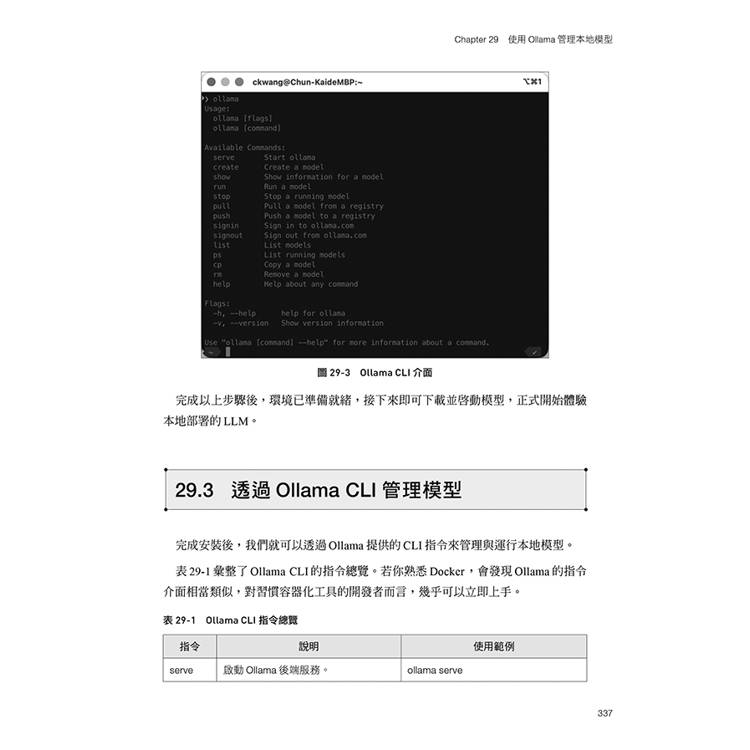

29.3 透過Ollama CLI管理模型

29.4 使用REST API

29.5 實作:使用LangChain建立終端機聊天機器人

|Chapter 30| 實作本地LLM應用案例:RAG文件問答助理

30.1 建構本地RAG應用

30.2 專案初始化與環境準備

30.3 實作:可檢索公司年報的AI問答系統

|Chapter 31| 使用LiteLLM建構多模型代理服務

31.1 從單一模型走向多模型架構

31.2 認識LiteLLM

31.3 部署LiteLLM

31.4 建立LiteLLM虛擬金鑰

31.5 測試LiteLLM API

31.6 使用LangChain存取LiteLLM API

|Chapter 32| 強化生成式AI應用的資安防護

32.1 當語言模型成為系統的一部分:LLM資安的新挑戰

32.2 從標準看風險:OWASP LLM Top 10

32.3 生成式AI應用的主要攻擊面

32.4 提示注入:最常見也最危險的攻擊手法

32.5 LLM的資料來源與信任邊界

32.6 當模型開始行動:AI Agent的權限與行為風險

32.7 LLM應用的安全設計原則

32.8 安全設計思維:打造多層防禦的LLM架構

32.9 結語:讓AI的創造力在安全邊界內發揮

【Part 06 附錄】

|Appendix A| 安裝與設定開發環境

|Chapter 01| 理解大型語言模型的核心概念

1.1 生成式AI的時代:從規則到語言理解

1.2 大型語言模型的核心概念

1.3 大型語言模型的能力與限制

|Chapter 02| 掌握OpenAI API的使用模式

2.1 為什麼選擇OpenAI

2.2 為什麼要使用AP

2.3 OpenAI API功能模組概覽

2.4 OpenAI GPT系列模型

2.5 Chat Completions API:對話核心介面

2.6 Responses API:支援狀態管理的對話介面

2.7 申請與管理OpenAI API金鑰

2.8 測試Chat Completion API

2.9 API使用限制與開發注意事項

|Chapter 03| 使用OpenAI API建立第一個應用

3.1 建立第一個OpenAI專案

3.2 專案初始化與環境準備

3.3 實作:建立可互動的終端機聊天機器人

3.4 提升對話體驗:使用串流模式

3.5 實作:支援串流模式的終端機聊天機器人

3.6 理解多輪對話機制:上下文與訊息角色

3.7 實作:支援多輪對話的終端機聊天機器人

|Chapter 04| 運用提示工程打造可控的角色與回應

4.1 認識提示工程:讓模型更懂你的指令

4.2 掌握提示結構:結合角色、任務與上下文

4.3 提示設計技巧:常用的引導方法與模式

4.4 實作:讓終端機聊天機器人擁有角色意識

|Chapter 05| 調控取樣參數Temperature與Top-P

5.1 理解模型如何生成回應

5.2 為何需要隨機性:從穩定回應到創意輸出

5.3 Temperature:控制模型的創意程度

5.4 Top-P:限制模型的選詞範圍

5.5 實作:讓CLI聊天機器人支援隨機性參數調整

|Chapter 06| 使用Function Calling讓模型呼叫工具

6.1 理解Function Calling機制

6.2 建立並執行Function Calling

6.3 實作:打造支援網路搜尋的終端機聊天機器人

【Part 02 LangChain核心應用】

|Chapter 07| 理解LangChain的核心概念與生態系

7.1 為什麼需要LangChain:從模型能力到應用挑戰

7.2 認識LangChain:打造LLM應用的核心框架

7.3 LangChain生態系:完整的應用開發平台

|Chapter 08| 使用LangChain建立LLM應用程式

8.1 建立第一個LangChain專案

8.2 專案初始化與環境準備

8.3 建立可互動的終端機聊天機器人

8.4 打造支援多輪對話的聊天機器人

8.5 使用串流模式提升對話體驗

|Chapter 09| 設計LangChain提示模板

9.1 為什麼需要提示模板

9.2 PromptTemplate:建立文字提示模板

9.3 ChatPromptTemplate:建立多角色對話提示

9.4 MessagesPlaceholder:插入歷史對話脈絡

|Chapter 10| 解析LangChain結構化輸出

10.1 為什麼需要輸出解析器

10.2 LangChain輸出解析器的運作流程

10.3 StringOutputParser:解析純文字輸出

10.4 JsonOutputParser:解析JSON輸出

10.5 CommaSeparatedListOutputParser:解析逗號分隔清單

10.6 StructuredOutputParser:結構與型別驗證輸出

10.7 OutputFixingParser:自動修復輸出

10.8 使用模型原生的結構化輸出

|Chapter 11| 使用LCEL組合流程鏈

11.1 認識LCEL

11.2 Runnable:LCEL的基本組成

11.3 RunnableSequence:順序執行Runnable

11.4 RunnableParallel:多個Runnable平行執行

11.5 RunnableLambda:自訂處理邏輯

11.6 LCEL的適用場景

|Chapter 12| 整合LangChain工具與代理

12.1 從工具到代理:讓模型具備行動力

12.2 Tool:讓模型能執行外部任務

12.3 Agent:讓模型自主決策與行動

|Chapter 13| 實作LangChain應用案例:AI部落格寫手

13.1 打造具網路搜尋能力的AI部落格寫手

13.2 專案初始化與環境準備

13.3 實作:具搜尋能力的AI部落格寫手

|Chapter 14| 追蹤與觀測LangChain執行流程

14.1 LLM應用的流程追蹤與可觀測性

14.2 LangChain的流程追蹤工具

14.3 Verbose模式:開發階段的即時追蹤與除錯

14.4 LangSmith:適用生產環境的可觀測平台

14.5 Langfuse:可自部署的LLM可觀測平台

【Part 03 RAG實戰應用】

|Chapter 15| 理解檢索增強生成

15.1 認識RAG

15.2 RAG的核心概念

15.3 LangChain如何支援RAG

|Chapter 16| 載入與分割文件

16.1 為什麼要載入與分割文件

16.2 文件載入器:將不同來源轉換為統一格式

16.3 文本分割器:將內容分割為可處理片段

|Chapter 17| 使用嵌入模型與向量資料庫

17.1 認識嵌入模型

17.2 語意向量的建立與查詢

17.3 認識向量資料庫

17.4 在LangChain中使用VectorStore

|Chapter 18| 結合檢索與生成

18.1 Retriever:封裝語意搜尋流程

18.2 建立基本的RAG流程

18.3 建立RAG Agent

|Chapter 19| 實作RAG應用案例:文件問答助理

19.1 打造可檢索公司年報的AI問答助理

19.2 專案初始化與環境準備

19.3 實作:可檢索公司年報的AI問答助理

【Part 04 LangGraph AI Agent實作】

|Chapter 20| 理解LangGraph的流程架構

20.1 為什麼需要LangGraph:從流程鏈到圖狀工作流

20.2 LangGraph的核心設計:以Graph描述Agent流程

20.3 State:LangGraph的核心資料結構

20.4 Nodes:LangGraph中的任務執行單位

20.5 Edges:決定流程要怎麼走

|Chapter 21| 使用LangGraph建立Agent流程

21.1 建立你的第一個LangGraph專案

21.2 專案初始化與環境準備

21.3 實作:建立基本的ReAct Agent

|Chapter 22| 打造多代理協作系統

22.1 為什麼需要多代理系統

22.2 多代理系統的設計模式

22.3 使用LangGraph實作多代理系統

22.4 設計多代理架構的協作模式

|Chapter 23| 設計人機協作流程

23.1 為什麼需要人機協作

23.2 LLM應用中的人機協作場景

23.3 使用LangGraph實現人機協作

23.4 人機協作的設計模式

23.5 使用Agent Middleware實作人機協作

|Chapter 24| 管理AI Agent記憶

24.1 認識AI Agent的記憶

24.2 短期記憶與長期記憶

24.3 短期記憶:追蹤當前對話與任務狀態

24.4 短期記憶的管理策略

24.5 長期記憶:跨會話的偏好與知識保存

24.6 設計長期記憶時的考量

|Chapter 25| 透過MCP連接第三方工具與資源

25.1 認識MCP

25.2 建立你的第一個MCP Server

25.3 建立MCP Client並呼叫工具

25.4 在LangGraph中整合MCP工具

25.5 整合外部服務:連接第三方MCP Server

|Chapter 26| 實作LangGraph應用案例:可審核與修訂的AI寫作Agent

26.1 打造具網路搜尋與人機協作能力的AI寫作Agent

26.2 專案初始化與環境準備

26.3 實作:具網路搜尋與人機協作能力的AI寫作Agent

26.4 建立CLI客戶端

|Chapter 27| 探索深度代理架構

27.1 認識深度代理

27.2 深度代理的四大核心支柱

27.3 打造並客製你的深度代理

【Part 05 本地LLM部署與安全設計】

|Chapter 28| 理解本地LLM的部署方案

28.1 為什麼需要在本地部署LLM

28.2 本地LLM部署的挑戰

28.3 常見的本地LLM部署方案

28.4 Hugging Face:模型生態與工具平台

28.5 常見的開放權重模型選擇

|Chapter 29| 使用Ollama管理本地模型

29.1 為什麼選擇Ollama

29.2 安裝Ollama

29.3 透過Ollama CLI管理模型

29.4 使用REST API

29.5 實作:使用LangChain建立終端機聊天機器人

|Chapter 30| 實作本地LLM應用案例:RAG文件問答助理

30.1 建構本地RAG應用

30.2 專案初始化與環境準備

30.3 實作:可檢索公司年報的AI問答系統

|Chapter 31| 使用LiteLLM建構多模型代理服務

31.1 從單一模型走向多模型架構

31.2 認識LiteLLM

31.3 部署LiteLLM

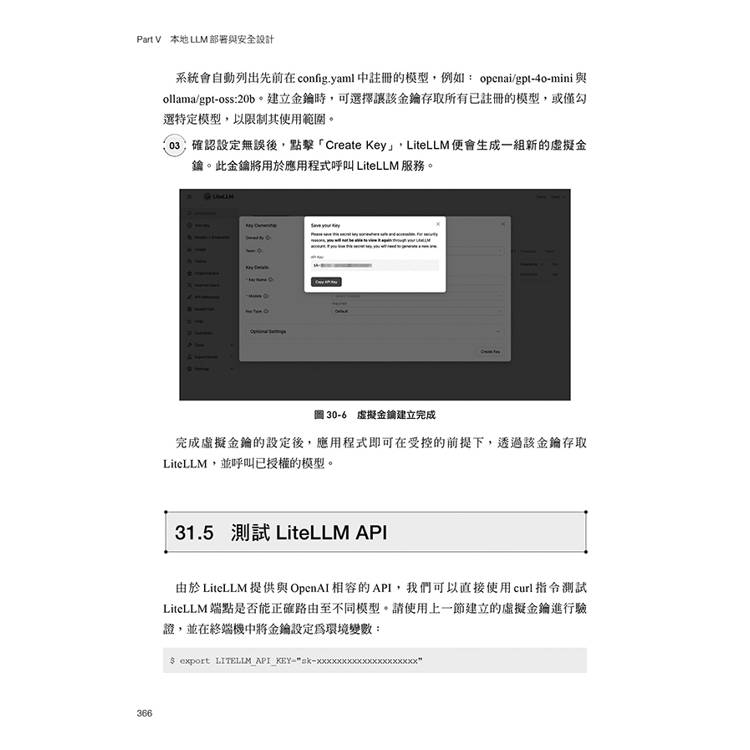

31.4 建立LiteLLM虛擬金鑰

31.5 測試LiteLLM API

31.6 使用LangChain存取LiteLLM API

|Chapter 32| 強化生成式AI應用的資安防護

32.1 當語言模型成為系統的一部分:LLM資安的新挑戰

32.2 從標準看風險:OWASP LLM Top 10

32.3 生成式AI應用的主要攻擊面

32.4 提示注入:最常見也最危險的攻擊手法

32.5 LLM的資料來源與信任邊界

32.6 當模型開始行動:AI Agent的權限與行為風險

32.7 LLM應用的安全設計原則

32.8 安全設計思維:打造多層防禦的LLM架構

32.9 結語:讓AI的創造力在安全邊界內發揮

【Part 06 附錄】

|Appendix A| 安裝與設定開發環境

配送方式

-

台灣

- 國內宅配:本島、離島

-

到店取貨:

不限金額免運費

-

海外

- 國際快遞:全球

-

港澳店取:

訂購/退換貨須知

退換貨須知:

**提醒您,鑑賞期不等於試用期,退回商品須為全新狀態**

-

依據「消費者保護法」第19條及行政院消費者保護處公告之「通訊交易解除權合理例外情事適用準則」,以下商品購買後,除商品本身有瑕疵外,將不提供7天的猶豫期:

- 易於腐敗、保存期限較短或解約時即將逾期。(如:生鮮食品)

- 依消費者要求所為之客製化給付。(客製化商品)

- 報紙、期刊或雜誌。(含MOOK、外文雜誌)

- 經消費者拆封之影音商品或電腦軟體。

- 非以有形媒介提供之數位內容或一經提供即為完成之線上服務,經消費者事先同意始提供。(如:電子書、電子雜誌、下載版軟體、虛擬商品…等)

- 已拆封之個人衛生用品。(如:內衣褲、刮鬍刀、除毛刀…等)

- 若非上列種類商品,均享有到貨7天的猶豫期(含例假日)。

- 辦理退換貨時,商品(組合商品恕無法接受單獨退貨)必須是您收到商品時的原始狀態(包含商品本體、配件、贈品、保證書、所有附隨資料文件及原廠內外包裝…等),請勿直接使用原廠包裝寄送,或於原廠包裝上黏貼紙張或書寫文字。

- 退回商品若無法回復原狀,將請您負擔回復原狀所需費用,嚴重時將影響您的退貨權益。

商品評價