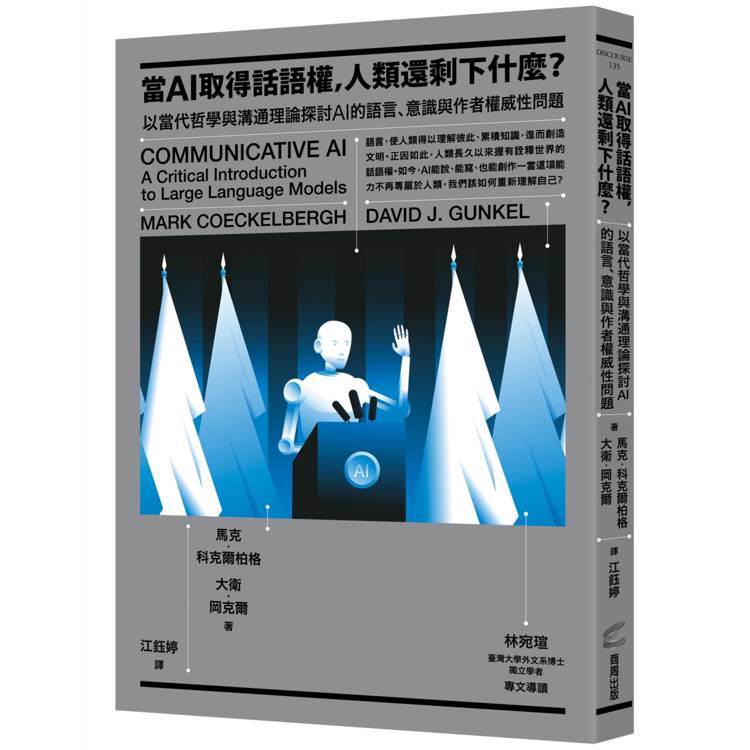

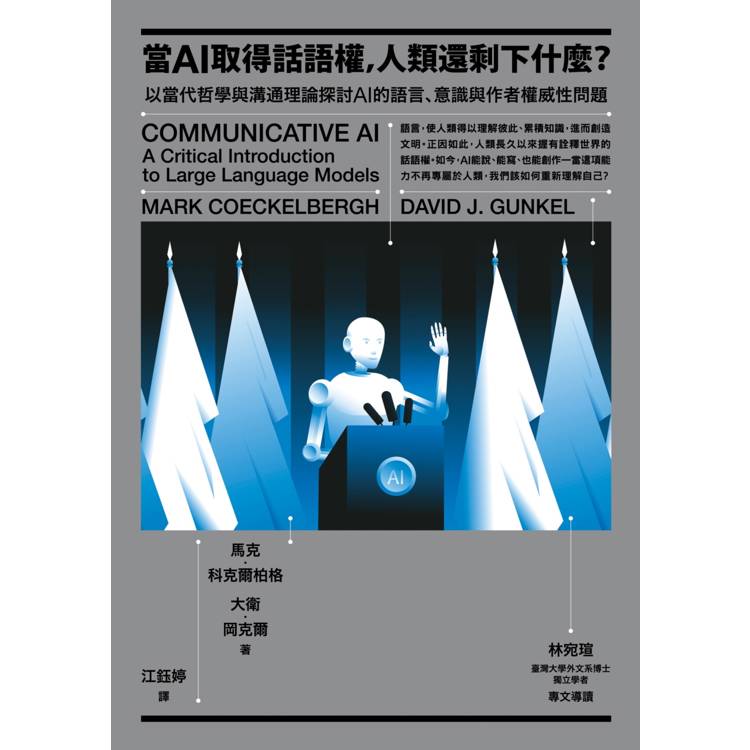

當AI取得話語權,人類還剩下什麼?:以當代哲學與溝通理論探討AI的語言、意識與作者權威性問題

活動訊息

內容簡介

Chat GPT、Gemini、Grok、Claude...各種AI工具現世,能寫、能說、能創作

這些原本都是人類獨有的技能,卻輕易地被AI奪走。

當機器開始取得話語權,是否代表人類的時代已經結束?

在AI浪潮之中,重新探尋人類與科技的關係!

本書特色

☛作者科克爾柏格與岡克爾專攻技術哲學與倫理,為你帶來「AI有自我意識嗎?」、「AI可以成為『人類』嗎?」、「AI會思考嗎?」等疑問的回應,重新思考AI在人文視角上帶給我們的危機!

☛以圖靈測試、溝通理論、羅蘭.巴特「作者已死」、柏拉圖等哲學理論,探究AI的語言、意識、智慧、作者權威性等議題,這些答案將改變人類對於AI的認知!

☛全面性的探討AI與人類的關係,不僅要懂得如何使用AI,更要懂AI對於人類的「意義」!

專文導讀

☛臺大外文系博士、獨立學者 林宛瑄

「《當AI取得話語權,人類還剩下什麼?》最具啟發性的觀點在於:我們確實需要以批判態度檢視LLM與其他生成式AI對語言、書寫與創作等領域造成的衝擊,但若持續執著於理體中心主義的形上學語言與書寫觀,並將人類以外的意義生產參與者排除在外,不僅無法回應新科技帶來的挑戰,反而可能錯失跳出框架、重新思考語言與書寫的契機。」

——〈是誰在說話重要嗎?從瑞斗日記到對話式AI的信任難題〉

本書簡介

在AI時代,人類正面臨前所未有的危機!

只要輸入幾句話就可以生成文章、圖片與任何所想要的東西,AI徹底翻轉「只有人類能做到的事」的認知,同時也動搖了人類的地位,迫使我們重新思考AI與我們之間的關係。這引起諸多在哲學上的關鍵問題:

☛AI有自我意識嗎?

二○二二年六月,前Google工程師勒模因曾宣稱LaDMA具有自我意識,即使最後不了了之,但是AI是否具有意識始終是幽靈般的懸問。

☛AI有思考的能力嗎?

現在AI已然通過了圖靈測試,字句、語氣與斷句無一不像人類,但是AI能「理解」自己在說什麼嗎?還是只是鸚鵡學舌?

☛AI可以成為「人類」嗎?

直到今天,諸多學術期刊與雜誌仍然只將「作者」的頭銜給予「真正的人類」,但是更多創作者加入了與AI共同創作的行列,甚至要求給予AI「作者」的頭銜......

☛人類的寫作還有未來嗎?

羅蘭.巴特的「作者已死」成真!只要動動手指、下提示詞,一篇文章彈指之間便可完成。這是寫作的末路,還是另一個新世界?

面對這些動搖人類地位的問題,我們必須追本溯源,回歸最基礎的定義與哲學上的提問:什麼是意識?什麼是語言?最重要的是,這些回答是否可以延伸至AI上?

作者馬克.科克爾柏格與大衛.岡克爾專攻機械哲學與技術哲學,多年鑽研機器、哲學與倫理相關的議題,本書不僅介紹LLM技術的運作機制,循序漸進探索AI與語言、意識等議題,甚至觸及AI所造成的社會與法律問題,科克爾柏格與岡克爾嘗試以當代哲學、語言學、思想實驗與溝通理論回應這些嶄新的議題,使我們重新思考AI對於語言、意識與作者權威性等所造成的衝擊。

這些原本都是人類獨有的技能,卻輕易地被AI奪走。

當機器開始取得話語權,是否代表人類的時代已經結束?

在AI浪潮之中,重新探尋人類與科技的關係!

本書特色

☛作者科克爾柏格與岡克爾專攻技術哲學與倫理,為你帶來「AI有自我意識嗎?」、「AI可以成為『人類』嗎?」、「AI會思考嗎?」等疑問的回應,重新思考AI在人文視角上帶給我們的危機!

☛以圖靈測試、溝通理論、羅蘭.巴特「作者已死」、柏拉圖等哲學理論,探究AI的語言、意識、智慧、作者權威性等議題,這些答案將改變人類對於AI的認知!

☛全面性的探討AI與人類的關係,不僅要懂得如何使用AI,更要懂AI對於人類的「意義」!

專文導讀

☛臺大外文系博士、獨立學者 林宛瑄

「《當AI取得話語權,人類還剩下什麼?》最具啟發性的觀點在於:我們確實需要以批判態度檢視LLM與其他生成式AI對語言、書寫與創作等領域造成的衝擊,但若持續執著於理體中心主義的形上學語言與書寫觀,並將人類以外的意義生產參與者排除在外,不僅無法回應新科技帶來的挑戰,反而可能錯失跳出框架、重新思考語言與書寫的契機。」

——〈是誰在說話重要嗎?從瑞斗日記到對話式AI的信任難題〉

本書簡介

在AI時代,人類正面臨前所未有的危機!

只要輸入幾句話就可以生成文章、圖片與任何所想要的東西,AI徹底翻轉「只有人類能做到的事」的認知,同時也動搖了人類的地位,迫使我們重新思考AI與我們之間的關係。這引起諸多在哲學上的關鍵問題:

☛AI有自我意識嗎?

二○二二年六月,前Google工程師勒模因曾宣稱LaDMA具有自我意識,即使最後不了了之,但是AI是否具有意識始終是幽靈般的懸問。

☛AI有思考的能力嗎?

現在AI已然通過了圖靈測試,字句、語氣與斷句無一不像人類,但是AI能「理解」自己在說什麼嗎?還是只是鸚鵡學舌?

☛AI可以成為「人類」嗎?

直到今天,諸多學術期刊與雜誌仍然只將「作者」的頭銜給予「真正的人類」,但是更多創作者加入了與AI共同創作的行列,甚至要求給予AI「作者」的頭銜......

☛人類的寫作還有未來嗎?

羅蘭.巴特的「作者已死」成真!只要動動手指、下提示詞,一篇文章彈指之間便可完成。這是寫作的末路,還是另一個新世界?

面對這些動搖人類地位的問題,我們必須追本溯源,回歸最基礎的定義與哲學上的提問:什麼是意識?什麼是語言?最重要的是,這些回答是否可以延伸至AI上?

作者馬克.科克爾柏格與大衛.岡克爾專攻機械哲學與技術哲學,多年鑽研機器、哲學與倫理相關的議題,本書不僅介紹LLM技術的運作機制,循序漸進探索AI與語言、意識等議題,甚至觸及AI所造成的社會與法律問題,科克爾柏格與岡克爾嘗試以當代哲學、語言學、思想實驗與溝通理論回應這些嶄新的議題,使我們重新思考AI對於語言、意識與作者權威性等所造成的衝擊。

目錄

【導讀】是誰在說話重要嗎?從瑞斗日記到對話式AI的信任難題 ◎林宛瑄

中文版作者序:機器講話,由誰來聽?

序

緒論

本書宗旨與方法

路線圖

#1大型語言模型101

自然語言處理

大型語言模型

技術的限制與挑戰

結論

#2倫理、法律與社會等面向的挑戰

幻覺

偏差

問責、監督與權力

經濟、社會與環境議題

隱私與安全性

抄襲與版權

#3智慧、意識與他心問題

機器智慧

論智慧之重要

語言與思想

#4語言、意義與溝通

關於語言與意義的兩種觀點

大型語言模型及語言

溝通:從傳播到混搭文化

關於大型語言模型的思考與討論

#5作者身分與權威

作者是什麼?

大型語言模型

機會與挑戰

結論與結果

#6真理、謊言與幻覺

事實不準確、錯誤資訊與幻覺

什麼是真理?柏拉圖的現實主義、真理符應論及其批評

真理受困?再訪LLM所生成的幻覺、胡扯與錯誤資訊

民主與LLM的責任發展

#7書寫有沒有未來?

理體中心主義及其影響

大型語言模型

書寫的未來

參考資料

中文版作者序:機器講話,由誰來聽?

序

緒論

本書宗旨與方法

路線圖

#1大型語言模型101

自然語言處理

大型語言模型

技術的限制與挑戰

結論

#2倫理、法律與社會等面向的挑戰

幻覺

偏差

問責、監督與權力

經濟、社會與環境議題

隱私與安全性

抄襲與版權

#3智慧、意識與他心問題

機器智慧

論智慧之重要

語言與思想

#4語言、意義與溝通

關於語言與意義的兩種觀點

大型語言模型及語言

溝通:從傳播到混搭文化

關於大型語言模型的思考與討論

#5作者身分與權威

作者是什麼?

大型語言模型

機會與挑戰

結論與結果

#6真理、謊言與幻覺

事實不準確、錯誤資訊與幻覺

什麼是真理?柏拉圖的現實主義、真理符應論及其批評

真理受困?再訪LLM所生成的幻覺、胡扯與錯誤資訊

民主與LLM的責任發展

#7書寫有沒有未來?

理體中心主義及其影響

大型語言模型

書寫的未來

參考資料

序/導讀

是誰在說話重要嗎?從瑞斗日記到對話式AI的信任難題

林宛瑄

《哈利波特:消失的密室》中,暗戀哈利的金妮.衛斯理,無意間得到一本日記。不論她在空白頁上寫下什麼心事,傾訴因為家境拮据而感到難過,或是戀情不順的痛苦,日記都會緊接著浮現體貼的話語與建議,耐心地安慰與鼓勵她。小金妮因而將這本自稱湯姆.瑞斗、且會「說人話」回應她的日記,視為知己摯友。後來哈利發現,這本瑞斗日記其實是佛地魔年輕時代製作的分靈體,透過親密的交談取得金妮的信任後,趁隙入侵並操縱她的心靈。危機解除後,衛斯理先生到霍格華茲接回女兒,氣極敗壞地告誡她:「我不是告訴過你嗎?永遠不要相信任何會自己思考,但你卻看不出它腦袋藏在哪裡的東西?」

金妮與瑞斗日記的初期互動,與當前人類和對話式 AI 的互動模式頗為雷同。而衛斯理先生對具備思考能力的非人類所展現的疑慮,也與人類面對大型語言模型(LLM)時的難以盡信如出一轍:雙方都擔憂這類「會說話的東西」可能帶來的負面效應。長期關注科技哲學與倫理議題的馬克.科克爾柏格與大衛.岡克爾,在《當AI取得話語權時,人類還剩下什麼?》中列舉了 LLM 所引發的倫理、法律與社會層面的挑戰,例如 LLM「幻覺」與錯誤資訊對個人與民主造成的傷害、預訓練資料所含偏見對演算法決策的影響、如何建立監督與問責機制以確保 AI 發展的民主化、科技失業與數位落差所加劇的不平等現象、LLM 的碳排放等環境成本問題、對話式 AI 訓練資料的侵權與資安疑慮,以及抄襲與版權的延伸爭議。

上述議題自 ChatGPT 問世以來,便反覆出現在各種討論之中。然而,本書的關注焦點並不在於盤點 AI 的技術風險或提出對應策略,而是試圖回到更根本的問題。作者從「機器會說話」這一現象切入,指出當非人類系統能夠流暢地生成語言時,將如何動搖我們對語言主體與作者身分等既有概念的理解。由此出發,本書進一步追問:機器是否真的理解語言?抑或只是看似在與人類溝通?它們能否參與意義的建構?這類會說話的機器,又將如何重塑智慧、語言與書寫的定義?本書提醒我們,打造對話式 AI 從來不只是科技問題,而是自始就涉及哲學問題,並踩在西方形上學的敏感神經上,從人們對圖靈測試的各種解讀即可見一斑。

圖靈測試是 AI 研究初期用來評估機器智慧的重要指標。由於「智慧」本身難以定義,我們也無法直接觀察其他智慧實體的內部運作,圖靈因此採取一種變通的方法,將機器是否能夠使用語言與人進行看似自然的對話,視為智慧展現的可觀察跡象。當代 LLM 能夠以與人類難以區分的語言使用方式與我們溝通,照理說已經破解了圖靈測試。然而,人類往往囿於例外論立場,難以接受智慧與語言並非人類的專利,於是一方面球員兼裁判,不斷調整並重設評估智慧的標準(科克爾柏格與岡克爾稱之為 AI 效應),以維持自身的特殊地位;另一方面則訴諸源自柏拉圖洞穴寓言的哲學判準,辯稱 LLM 只是「看起來像是在使用語言」,實際上並不真正理解語言,因此對話式 AI 本質上是一種帶有欺騙性的存在。

科克爾柏格與岡克爾指出,如果「AI 幻覺」一詞是將人類特徵投射到機器上的產物,那麼這類 AI 欺騙的指控,則反映了人類中心語言觀的防衛反應。在由柏拉圖洞穴寓言與亞里斯多德語言理論所建構的框架中,人類被視為唯一真正掌握語言的主體。我們具有溝通的動機,並以語言作為工具,表達自身想法或表徵外在事物,在符號與現實之間建立關聯,從而產生意義。依此語言觀來看,LLM 並沒有表達自我的意圖,其生成的語言只能指稱洞穴中的黑影,而非外在世界,因此不過是能模擬語言使用的隨機鸚鵡,或只是拿訓練資料進行文字接龍的幹話機器。

但若從另一種去中心化的語言觀來看,人類語言使用者與 LLM 一樣,都是寄生於語言系統之中的存在。結構主義、後結構主義與理體中心主義等語言哲學取向主張,人類並非掌控語言的主體,而是受制於語言結構的存在。如果說仰賴預訓練資料的 LLM 是人類語言系統的寄生者,那麼同樣必須依賴既有言語與書寫的人類,其實也不過是半斤八兩。當語言主體的概念被去中心化之後,語言便「不在於溝通你腦袋中的東西;它不只在於『你』說了什麼,語言本身也在說話。因此,究竟是誰或甚麼在說話——講者或作者——其實並不那麼重要,也無法決定甚麼會被說出來」。進一步而言,符號與現實之間的對應關係也不再是唯一的意義來源;去中心化溝通過程中的所有參與者,不論是人類或非人類,都能共同參與意義的建構。科克爾柏格與岡克爾認為,LLM 的語言運作方式正與這樣的另類語言觀高度相容,唯有將其納入思考,對於對話式 AI 的批判才不會停留在挑剔 AI 哪裡不如人,甚至因此沾沾自喜。我們更需要藉此反思語言觀如何形塑我們的看法,並看見 LLM 如何與我們共同生產意義。

除了重塑我們對語言的理解之外,LLM 也「中斷、干擾並解構」了人們對作者身分的既有想像。一般而言,人們會認為作者就是撰寫文本並為其內容負責的人,但這種看似理所當然的作者概念,其實是在現代歐洲思想文化脈絡中逐步形成的結果,並呼應了「我思故我在」、新教因信稱義觀,以及個人財產制等預設的個別化思惟。在此框架下,作者身分被塑造成一種文學權威角色,被視為賦予文本意義與價值的來源,理解作者思想也因此成為閱讀與詮釋文本的基本原則。在法律層面上,作者更是當代版權制度的核心人物,被認定為原創作品的合法所有人,同時也是法律用來追究作品內容問題的責任主體。

然而,習以為常並不代表天經地義。羅蘭.巴特與米歇爾.傅柯分別以「作者已死」與「是誰在說話重要嗎?」質疑作者權威,強調作品事實上是多重書寫交織的結果,作者身分始終分散於文本網絡之中。而不論作品如何產生,其意義最終都是由讀者在閱讀過程中的詮釋所建構。科克爾柏格與岡克爾指出,LLM 正好在實作層面上實現了巴特與傅柯的理論:在沒有署名作者的情況下生成內容,而這些內容也如同人類書寫一般,透過讀者的閱讀、詮釋與評價而產生意義,僅以「AI 胡扯」或「AI 垃圾」加以否定,未免失之偏頗。LLM 對作者身分帶來的挑戰,確實動搖了長期運作的創作認定、版權歸屬與作品問責模式,但許多當前的回應方式,仍試圖重申個別化作者的權威,並將其擴張以涵蓋對話式 AI 的生成內容。本書提醒我們,若從巴特與傅柯對作者角色的批判出發,或許可以理解 LLM 只是揭示了個別化作者概念本身的侷限,在挑戰既有秩序的同時,也「開啟了以不同方式思考與書寫的機會」。

本書最具啟發性的觀點在於:我們確實需要以批判態度檢視 LLM 與其他生成式 AI 對語言、書寫與創作等領域造成的衝擊,但若持續執著於理體中心主義的形上學語言與書寫觀,並將人類以外的意義生產參與者排除在外,不僅無法回應新科技帶來的挑戰,反而可能錯失跳出框架、重新思考語言與書寫的契機。因此,問題或許不在於AI是否帶有欺騙性,或是我們能否相信非人類系統所生成的內容,而在於我們是基於甚麼樣的思考方式,來詢問「是否能相信」這個問題。瑞斗日記之所以不可信任,關鍵在於佛地魔的邪惡意圖;而不具人類作者意圖的 LLM,毋寧構成了一種邀請:邀請我們開放對語言、書寫、閱讀、詮釋與意義的想像。發話者或書寫者是否擁有一個人類認可的「腦袋」,其實並不重要;正如本書反覆強調的:「是誰在說話重要嗎?」只要能共同參與意義的生產,話語「即使是由橡木、石頭或 LLM 所生成的,也沒有不同」。

林宛瑄

《哈利波特:消失的密室》中,暗戀哈利的金妮.衛斯理,無意間得到一本日記。不論她在空白頁上寫下什麼心事,傾訴因為家境拮据而感到難過,或是戀情不順的痛苦,日記都會緊接著浮現體貼的話語與建議,耐心地安慰與鼓勵她。小金妮因而將這本自稱湯姆.瑞斗、且會「說人話」回應她的日記,視為知己摯友。後來哈利發現,這本瑞斗日記其實是佛地魔年輕時代製作的分靈體,透過親密的交談取得金妮的信任後,趁隙入侵並操縱她的心靈。危機解除後,衛斯理先生到霍格華茲接回女兒,氣極敗壞地告誡她:「我不是告訴過你嗎?永遠不要相信任何會自己思考,但你卻看不出它腦袋藏在哪裡的東西?」

金妮與瑞斗日記的初期互動,與當前人類和對話式 AI 的互動模式頗為雷同。而衛斯理先生對具備思考能力的非人類所展現的疑慮,也與人類面對大型語言模型(LLM)時的難以盡信如出一轍:雙方都擔憂這類「會說話的東西」可能帶來的負面效應。長期關注科技哲學與倫理議題的馬克.科克爾柏格與大衛.岡克爾,在《當AI取得話語權時,人類還剩下什麼?》中列舉了 LLM 所引發的倫理、法律與社會層面的挑戰,例如 LLM「幻覺」與錯誤資訊對個人與民主造成的傷害、預訓練資料所含偏見對演算法決策的影響、如何建立監督與問責機制以確保 AI 發展的民主化、科技失業與數位落差所加劇的不平等現象、LLM 的碳排放等環境成本問題、對話式 AI 訓練資料的侵權與資安疑慮,以及抄襲與版權的延伸爭議。

上述議題自 ChatGPT 問世以來,便反覆出現在各種討論之中。然而,本書的關注焦點並不在於盤點 AI 的技術風險或提出對應策略,而是試圖回到更根本的問題。作者從「機器會說話」這一現象切入,指出當非人類系統能夠流暢地生成語言時,將如何動搖我們對語言主體與作者身分等既有概念的理解。由此出發,本書進一步追問:機器是否真的理解語言?抑或只是看似在與人類溝通?它們能否參與意義的建構?這類會說話的機器,又將如何重塑智慧、語言與書寫的定義?本書提醒我們,打造對話式 AI 從來不只是科技問題,而是自始就涉及哲學問題,並踩在西方形上學的敏感神經上,從人們對圖靈測試的各種解讀即可見一斑。

圖靈測試是 AI 研究初期用來評估機器智慧的重要指標。由於「智慧」本身難以定義,我們也無法直接觀察其他智慧實體的內部運作,圖靈因此採取一種變通的方法,將機器是否能夠使用語言與人進行看似自然的對話,視為智慧展現的可觀察跡象。當代 LLM 能夠以與人類難以區分的語言使用方式與我們溝通,照理說已經破解了圖靈測試。然而,人類往往囿於例外論立場,難以接受智慧與語言並非人類的專利,於是一方面球員兼裁判,不斷調整並重設評估智慧的標準(科克爾柏格與岡克爾稱之為 AI 效應),以維持自身的特殊地位;另一方面則訴諸源自柏拉圖洞穴寓言的哲學判準,辯稱 LLM 只是「看起來像是在使用語言」,實際上並不真正理解語言,因此對話式 AI 本質上是一種帶有欺騙性的存在。

科克爾柏格與岡克爾指出,如果「AI 幻覺」一詞是將人類特徵投射到機器上的產物,那麼這類 AI 欺騙的指控,則反映了人類中心語言觀的防衛反應。在由柏拉圖洞穴寓言與亞里斯多德語言理論所建構的框架中,人類被視為唯一真正掌握語言的主體。我們具有溝通的動機,並以語言作為工具,表達自身想法或表徵外在事物,在符號與現實之間建立關聯,從而產生意義。依此語言觀來看,LLM 並沒有表達自我的意圖,其生成的語言只能指稱洞穴中的黑影,而非外在世界,因此不過是能模擬語言使用的隨機鸚鵡,或只是拿訓練資料進行文字接龍的幹話機器。

但若從另一種去中心化的語言觀來看,人類語言使用者與 LLM 一樣,都是寄生於語言系統之中的存在。結構主義、後結構主義與理體中心主義等語言哲學取向主張,人類並非掌控語言的主體,而是受制於語言結構的存在。如果說仰賴預訓練資料的 LLM 是人類語言系統的寄生者,那麼同樣必須依賴既有言語與書寫的人類,其實也不過是半斤八兩。當語言主體的概念被去中心化之後,語言便「不在於溝通你腦袋中的東西;它不只在於『你』說了什麼,語言本身也在說話。因此,究竟是誰或甚麼在說話——講者或作者——其實並不那麼重要,也無法決定甚麼會被說出來」。進一步而言,符號與現實之間的對應關係也不再是唯一的意義來源;去中心化溝通過程中的所有參與者,不論是人類或非人類,都能共同參與意義的建構。科克爾柏格與岡克爾認為,LLM 的語言運作方式正與這樣的另類語言觀高度相容,唯有將其納入思考,對於對話式 AI 的批判才不會停留在挑剔 AI 哪裡不如人,甚至因此沾沾自喜。我們更需要藉此反思語言觀如何形塑我們的看法,並看見 LLM 如何與我們共同生產意義。

除了重塑我們對語言的理解之外,LLM 也「中斷、干擾並解構」了人們對作者身分的既有想像。一般而言,人們會認為作者就是撰寫文本並為其內容負責的人,但這種看似理所當然的作者概念,其實是在現代歐洲思想文化脈絡中逐步形成的結果,並呼應了「我思故我在」、新教因信稱義觀,以及個人財產制等預設的個別化思惟。在此框架下,作者身分被塑造成一種文學權威角色,被視為賦予文本意義與價值的來源,理解作者思想也因此成為閱讀與詮釋文本的基本原則。在法律層面上,作者更是當代版權制度的核心人物,被認定為原創作品的合法所有人,同時也是法律用來追究作品內容問題的責任主體。

然而,習以為常並不代表天經地義。羅蘭.巴特與米歇爾.傅柯分別以「作者已死」與「是誰在說話重要嗎?」質疑作者權威,強調作品事實上是多重書寫交織的結果,作者身分始終分散於文本網絡之中。而不論作品如何產生,其意義最終都是由讀者在閱讀過程中的詮釋所建構。科克爾柏格與岡克爾指出,LLM 正好在實作層面上實現了巴特與傅柯的理論:在沒有署名作者的情況下生成內容,而這些內容也如同人類書寫一般,透過讀者的閱讀、詮釋與評價而產生意義,僅以「AI 胡扯」或「AI 垃圾」加以否定,未免失之偏頗。LLM 對作者身分帶來的挑戰,確實動搖了長期運作的創作認定、版權歸屬與作品問責模式,但許多當前的回應方式,仍試圖重申個別化作者的權威,並將其擴張以涵蓋對話式 AI 的生成內容。本書提醒我們,若從巴特與傅柯對作者角色的批判出發,或許可以理解 LLM 只是揭示了個別化作者概念本身的侷限,在挑戰既有秩序的同時,也「開啟了以不同方式思考與書寫的機會」。

本書最具啟發性的觀點在於:我們確實需要以批判態度檢視 LLM 與其他生成式 AI 對語言、書寫與創作等領域造成的衝擊,但若持續執著於理體中心主義的形上學語言與書寫觀,並將人類以外的意義生產參與者排除在外,不僅無法回應新科技帶來的挑戰,反而可能錯失跳出框架、重新思考語言與書寫的契機。因此,問題或許不在於AI是否帶有欺騙性,或是我們能否相信非人類系統所生成的內容,而在於我們是基於甚麼樣的思考方式,來詢問「是否能相信」這個問題。瑞斗日記之所以不可信任,關鍵在於佛地魔的邪惡意圖;而不具人類作者意圖的 LLM,毋寧構成了一種邀請:邀請我們開放對語言、書寫、閱讀、詮釋與意義的想像。發話者或書寫者是否擁有一個人類認可的「腦袋」,其實並不重要;正如本書反覆強調的:「是誰在說話重要嗎?」只要能共同參與意義的生產,話語「即使是由橡木、石頭或 LLM 所生成的,也沒有不同」。

配送方式

-

台灣

- 國內宅配:本島、離島

-

到店取貨:

不限金額免運費

-

海外

- 國際快遞:全球

-

港澳店取:

訂購/退換貨須知

退換貨須知:

**提醒您,鑑賞期不等於試用期,退回商品須為全新狀態**

-

依據「消費者保護法」第19條及行政院消費者保護處公告之「通訊交易解除權合理例外情事適用準則」,以下商品購買後,除商品本身有瑕疵外,將不提供7天的猶豫期:

- 易於腐敗、保存期限較短或解約時即將逾期。(如:生鮮食品)

- 依消費者要求所為之客製化給付。(客製化商品)

- 報紙、期刊或雜誌。(含MOOK、外文雜誌)

- 經消費者拆封之影音商品或電腦軟體。

- 非以有形媒介提供之數位內容或一經提供即為完成之線上服務,經消費者事先同意始提供。(如:電子書、電子雜誌、下載版軟體、虛擬商品…等)

- 已拆封之個人衛生用品。(如:內衣褲、刮鬍刀、除毛刀…等)

- 若非上列種類商品,均享有到貨7天的猶豫期(含例假日)。

- 辦理退換貨時,商品(組合商品恕無法接受單獨退貨)必須是您收到商品時的原始狀態(包含商品本體、配件、贈品、保證書、所有附隨資料文件及原廠內外包裝…等),請勿直接使用原廠包裝寄送,或於原廠包裝上黏貼紙張或書寫文字。

- 退回商品若無法回復原狀,將請您負擔回復原狀所需費用,嚴重時將影響您的退貨權益。

商品評價